上周,一家AI公司在美国国防部面前说了“不”。

后果来得很快。当地时间2月27日,美国政府宣布将Anthropic列入“供应链风险”黑名单, 这意味着任何与美国军方合作的公司如果敢用Anthropic的东西,就会丢掉政府生意(和当初华为一个待遇) 。

总统特朗普也发文猛批Anthropic为“左翼疯子”“觉醒公司”,下令所有联邦机构立即停止使用Anthropic技术(留6个月过渡期)。

最后是一个罕见的标签——“国家安全供应链风险”——被贴到了这家公司身上。对于Anthropic来说,这意味着基本告别了美国联邦政府的生意圈。任何跟军方有往来的承包商,如果还敢用Anthropic的东西,就会丢掉政府订单——和当初华为一个待遇。

表面上看,这是一家公司和军方谈崩了的故事。但往深了看,这可能是一个我们未来会反复看到的剧本:当技术公司想给自己的产品划红线,而掌握权力的那一方拒绝接受这些红线时,会发生什么。

他们要的不是合作,是控制

事情要从五角大楼的一个要求说起。

去年7月,美国国防部跟Anthropic、谷歌、OpenAI、xAI等四家公司签了约2亿美元的合同,让它们为军事应用提供AI模型。到目前为止,Anthropic的Claude是唯一被允许接入美军机密系统的商业AI模型,可以处理高级别的情报,用于情报分析、作战规划、网络作战等任务。

但问题很快就来了。今年1月,美军在强行控制委内瑞拉总统马杜罗的行动中,用了Claude协助作战,而Anthropic对此一无所知。得知消息后,公司向五角大楼求证并表达了“深度关切”。这件事激化了双方的矛盾。

随后,五角大楼提出了新要求:Anthropic必须解除所有使用限制,允许军方将模型用于“所有合法用途”。

Anthropic没答应。他们一直守着两条规矩:不用于完全自主的武器系统(也就是杀手机器人,无需人类干预),不用于对美国公民的大规模监控。

这看起来像是一个伦理立场问题,但Anthropic CEO达里奥·阿莫迪在周四的公开信里给出了更务实的解释:现在的AI还没可靠到可以上战场。在不可预测的环境里,AI一旦出错,轻则友军误伤,重则局势升级。至于监控那条,他的担忧也很直接——现行法律管不住AI能从数据里挖出的那些深层推论,这可能会踩到宪法的线。

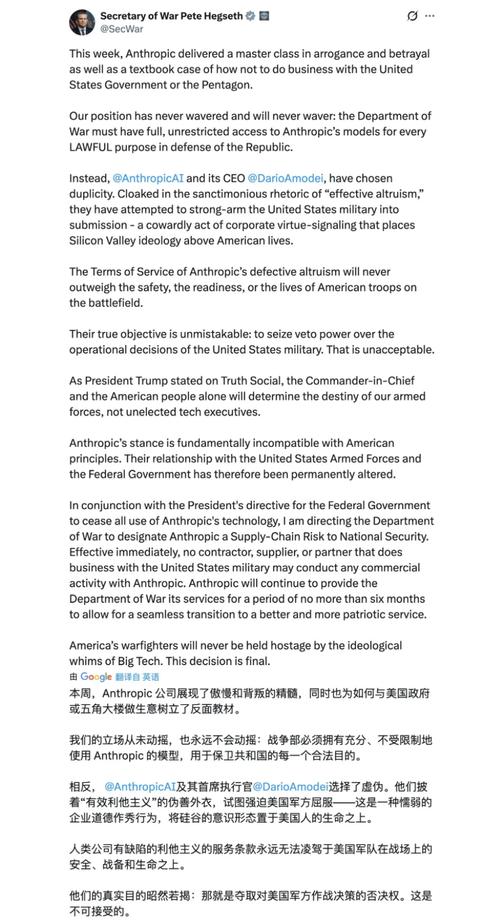

周二,国防部长皮特·赫格塞斯约见了阿莫迪。见面氛围不太好,赫格塞斯给了最后期限:周五下午5点01分之前不改变主意,后果自负。

阿莫迪没有改变主意。他在周四发表声明:“这些威胁不会改变我们的立场。我们无法违背良知接受他们的要求。”

周五,特朗普在Truth Social上发文:“美国永远不会允许一个激进的左翼觉醒公司来指挥我们的伟大军队如何打仗和打赢战争!这个决定属于你们的总司令。”他下令所有联邦机构在六个月内停止使用Anthropic的产品。

紧接着,国防部长赫格塞斯宣布将Anthropic列为“国家安全供应链风险”。这个标签的杀伤力在于,它不光是自己不跟Anthropic做生意,还会连累任何想跟军方做生意的人——那些承包商、供应商、合作伙伴,如果想保住军方的订单,就得主动切断跟Anthropic的所有往来。

有意思的是,这个标签以前一般是给那些“跟外国对手有关联”的公司用的。Anthropic大概没想到,自己因为“不听话”也能享受这个待遇。

硅谷的反应:有人声援,有人站队

Anthropic不是硅谷最大的AI公司,但它这次的态度引发了一波罕见的同行声援。

OpenAI的萨姆·奥尔特曼公开表态支持。他在周五早上告诉CNBC,和军方合作没问题,但前提是“遵守法律保护”以及“我们和Anthropic共享的那几条红线”。他还在一份发给员工的内部备忘录里说,OpenAI正在跟五角大楼谈判,争取在部署模型时能排除用于美国境内监控或自主武器的情况。

超过200名来自谷歌和OpenAI的员工签署了公开信,呼吁自己的公司也守住底线。就连亚马逊、谷歌、微软、OpenAI的员工工会联盟都发了声明,要求各自公司学学Anthropic。

这些人支持的不光是Anthropic的立场,更是对自己手里那点技术命运的控制权。硅谷的工程师们普遍有一种焦虑:自己写出来的代码,最后会被用在什么地方?

但硅谷也不是铁板一块。马斯克的xAI就站在了政府那边。据报道,xAI已经签了协议,准备把Grok聊天机器人接入美军机密系统。谷歌也“接近”达成类似协议。马斯克本人还在X上嘲讽Anthropic:“绝了,他们怎么敢偷Anthropic从人类程序员那里‘偷’来的东西?”——这句话是冲着Anthropic刚发的另一份报告去的。

一个退役将军说了句公道话

杰克·沙纳汉是美国空军的退役上将,也曾经是五角大楼的AI负责人。他对这件事的评价可能最接近事情的本质。

他说,Anthropic的技术已经在政府内部用了很久,他们设的那些红线其实是“合理的”。把矛头对准Anthropic虽然能上头条,但“最后所有人都是输家”。

这话说得挺准。

Anthropic输了,丢了一个大客户,还被封杀了整个政府市场。

五角大楼也输了,虽然杀了鸡儆了猴,但以后那些真正有想法的技术公司,可能更不愿意跟军方合作了。留下的那些愿意无条件接单的,未必是最好的。

对整个AI行业来说,这件事开了个先例:原来政府可以因为一家公司不听话,就用“供应链风险”这种手段把它边缘化。以后再有公司想在伦理问题上跟政府讨价还价,想想Anthropic的下场,可能就得掂量掂量了。

谁来决定技术的边界

Anthropic这件事,说到底是一个问题:谁有权给技术画红线?

在Anthropic看来,他们创造了这项技术,有权决定它不能被用在哪些地方。

在五角大楼看来,国家安全需要压倒一切,技术公司没有资格对军方说不。

这两种逻辑的冲突,在这次事件里以一种极端的方式呈现出来。但可以想见,随着AI越来越深地嵌入军事、安防、情报这些领域,类似的冲突只会越来越多。

Anthropic的“抗命”是一个信号。它标志着有一部分技术创造者,开始认真思考自己手里那点权力的边界在哪里。而华盛顿的回应同样是一个信号:在国家权力面前,这种思考的代价可能很高。

谁对谁错,可能没有标准答案。但有一点是确定的:这不会是个孤案。